November 2023

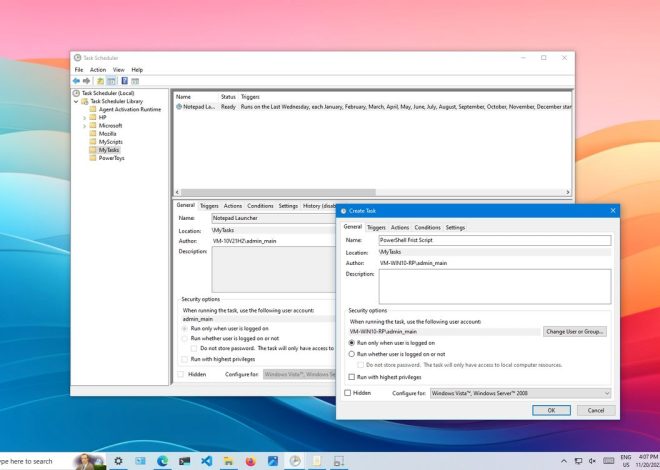

Sådan opretter du en automatiseret opgave ved hjælp af Task Scheduler på Windows 10

På Windows 10 lader opgaveplanlægningen dig oprette og køre opgaver automatisk, og i denne vejledning vil jeg skitsere trinene for at fuldføre processen. Typisk bruger operativsystemet og visse apps skemalæggeren til at automatisere vedligeholdelsesopgaver (såsom diskdefragmentering, diskoprydning og opdateringer). Du kan dog bruge det til at automatisere dine egne opgaver. For eksempel kan du starte […]

ExLlamaV2: Det hurtigste bibliotek til at køre LLM’er

Kvantiser og kør EXL2-modeller Billede af forfatter Quantizing Large Language Models (LLM’er) er den mest populære tilgang til at reducere størrelsen af disse modeller og fremskynde inferens. Blandt disse teknikker leverer GPTQ fantastisk ydeevne på GPU’er. Sammenlignet med ikke-kvantiserede modeller bruger denne metode næsten 3 gange mindre VRAM, mens den giver et tilsvarende niveau af […]

De 14 bedste websteder til at downloade film- og tv-scripts

Tabb hjalp med at bygge verden af det roste Sterlin Harjo/Taika Waititi show, Reservationshunde, som indeholdt en cast af friske unge oprindelige karakterer og deres voksne vogtere. Den sidste sæson af showet, som bøjede sidste år, tog publikum i nogle nye retninger, ind i flashbacks som i “Deer Lady” og “House Made of Bongs”, men […]

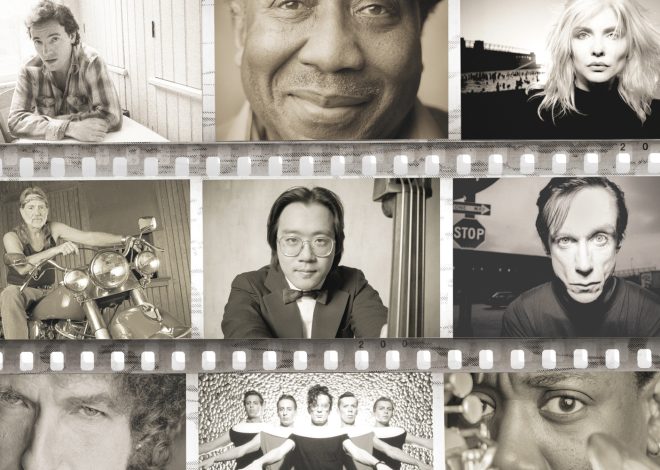

Billede og lyd – Boulder Weekly

Kredit: David Michael Kennedy Da Katie Selvage trådte ind i et beskedent Santa Fe-galleri for at få inspiration til at tage hjem til sit eget kunstrum i Boulder, vidste hun ikke, at hun ville tage afsted med en kuffertfuld rock ‘n’ roll-historie på slæb. Selvage havde udforsket det sydvestlige kulturcentrum sammen med sin mand Patrick, […]

Sådan sender du et script til os

Hvad er Open Call-muligheden for manuskriptindsendelser? I stedet for at acceptere scripts året rundt, har vi særskilte indsendelsesvinduer for scripts, som annonceres på BBC Writers Opportunities-siden i løbet af året. Hvert åbent opkald har en deadline, hvorefter de modtagne manuskripter vurderes intensivt af vores manuskriptlæsere og BBC Writers-teamet, og der udarbejdes en shortliste. Vi tilbyder […]